Caitlin startte met de uitleg wat het verschil is tussen mensen en Artificial Intelligence. Mensen leren van ervaringen en kunnen kritisch nadenken over wat zij geleerd hebben. AI ziet alleen patronen in data, oordeelt niet, betwijfelt niets en presenteert het gevraagde als ‘waarheid’.

Wanneer AI de ‘oude’ wereld kopieert – en ongelijkheid vergroot

Het grote probleem van de data is dat deze data vooral afkomstig zijn uit West-Europa en Noord-Amerika. De data representeren vooral de gemiddelde man: blank, 20–30 jaar oud, 180 cm lang, 70 kg en West‑Europees of Noord‑Amerikaans. Data over vrouwen zijn vaak incompleet, geven een eenzijdig beeld of ontbreken zelfs. Dat geldt ook voor andere diversiteitskenmerken als religie, ras, seksuele voorkeur enz.

Technologie zou neutraal en objectief moeten zijn. Maar AI leert niet wat eerlijk is; AI leert wat wij het voeden. En als de data vol zit met genderstereotypen en historische ongelijkheid, dan wordt dat ongelijk automatisch gereproduceerd op wereldwijde schaal. Van medische diagnose tot sollicitaties, van bankkrediet tot nieuwsvoorziening en zelfs rechtspraak: algoritmen bepalen steeds vaker wie welke kansen krijgt. Voor vrouwen en meisjes kan dat verstrekkende gevolgen hebben.

Een bekend voorbeeld komt uit de bedrijfswereld. Amazon ontwikkelde een AI-systeem om sollicitanten te beoordelen, in de hoop de beste kandidaten efficiënter te selecteren. Omdat in het verleden vooral mannen aangenomen waren, “leerde” de AI dat mannen betere medewerkers zijn. Het systeem begon vrouwelijke kandidaten systematisch lager te scoren. Het verleden werd waarheid – inclusief oude vooroordelen.

Als vrouwen niet aan tafel zitten, worden ze vergeten

Bias (vooroordeel in denken, beslissen of oordelen) ontstaat niet alleen door data, maar ook door wie technologie ontwikkelt. De techwereld is nog steeds overwegend mannelijk, wat onbewust leidt tot blinde vlekken.

In 2014 lanceerde Apple bijvoorbeeld de HealthKit-app, bedoeld om “alle gezondheidsstatistieken” van gebruikers te monitoren. Een indrukwekkende lijst functies werd gelanceerd, maar één essentieel onderdeel ontbrak: menstruatie-tracking. Voor de helft van de wereldbevolking ontbrak een basisfunctie. Niet omdat het kwaadwillend was — maar omdat niemand eraan dacht.

Het laat zien hoe belangrijk het is dat vrouwen betrokken zijn bij ontwerp, onderzoek, data-verzameling en besluitvorming in technologie.

Data-gaten in de gezondheidszorg: gevaarlijk voor vrouwen

Vrouwen worden al decennia ondervertegenwoordigd in geneeskundig onderzoek. Zo nemen slechts 38% van de klinische studies vrouwen op. Symptomen van hartaanvallen, werkingen van medicatie, pijnbeleving — veel van wat we “medische feiten” noemen, is gebaseerd op mannen. AI-systemen die op die medische data worden getraind, missen informatie over vrouwenlichamen, met potentieel levensgevaarlijke gevolgen.

Genderongelijkheid wordt ‘technisch onzichtbaar’

Één van de grootste risico’s van AI is dat discriminatie steeds minder zichtbaar wordt — en daardoor moeilijker aan te vechten.

In 2019 bleek de Apple–Goldman Sach-kredietkaart vrouwen structureel lagere kredietlimieten toe te kennen dan mannen met hetzelfde financiële profiel. Het systeem vroeg niet om gender — maar reconstrueerde het via andere gegevens. Wat genderneutraal leek, bleek een digitale vorm van discriminatie. Het algoritme baseerde de afwijzing op het geringe aantal vrouwen dat in het verleden een lening had gekregen waardoor deze groep als ‘niet veilig’ werd bestempeld.

Het probleem wordt versterkt doordat algoritmen beslissingen maken op plekken waar mensen het nauwelijks doorhebben: in banken, ziekenhuizen, scholen, rechtbanken en sociale media. Bias verschuift van menselijk naar systeemniveau, waar hij veel moeilijker te herkennen én te corrigeren is.

Mis- en desinformatie: groot mondiaal risico

Het Wereld Economisch Forum benoemde mis- en desinformatie als het grootste mondiale risico voor de komende jaren. Ze verklaarden dat “zowel buitenlandse als binnenlandse actoren misvatting en desinformatie zullen gebruiken om de maatschappelijke en politieke scheidslijnen te vergroten.”

Daarom is het NU belangrijk om AI recht te zetten.

Wat kunnen wij doen?

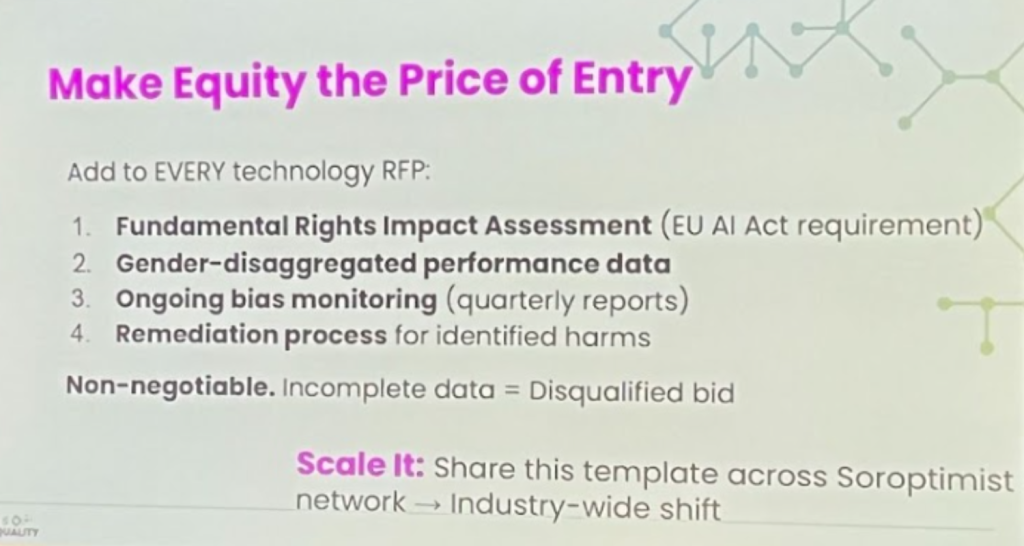

Caitlin’s oproep is om als betrokken burger je lokale overheid te bevragen hoe deze omgaat met AI. Met de Europese AI Act in de hand kan je heel goed vragen stellen. Vanuit de SIE AI taskforce wordt gewerkt aan advocacy op AI – later meer nieuws hierover.

We staan op een cruciaal punt: nu is het moment om AI te vormen, voordat de ongelijkheid die erin zit onomkeerbaar ingebakken raakt. De EU AI Act biedt een wettelijk kader, maar handhaving en controle zijn nodig om te voorkomen dat organisaties aan regels ontsnappen. Impactanalyses moeten echt zijn, niet een afvinkoefening. En genderanalyse moet verplicht worden wanneer AI mensenrechten raakt.

AI hoeft ongelijkheid niet te vergroten — het kan haar ook doorbreken. Als vrouwen, meisjes en gemarginaliseerde groepen zichtbaar worden in data, in technologie en in besluitvorming, kan AI juist bijdragen aan gelijke toegang tot zorg, onderwijs, werk en veiligheid. Daarvoor is één ding nodig: vrouwen moeten meebouwen.

| Als netwerk van vrouwen die zich wereldwijd inzetten voor empowerment en gelijke rechten, heeft Soroptimist International een unieke rol in het AI-tijdperk: 1. Bewustwording creëren Binnen clubs, scholen en gemeenschappen: AI moet een vast onderdeel worden van vrouwenrechteneducatie. 2. Beleidsverandering ondersteunen De EU AI Act is een belangrijke stap — maar alleen effectief als we toezien op strikte handhaving en genderimpact-analyses. 3. Vrouwen stimuleren om STEM en AI in te gaan We hebben vrouwelijke datawetenschappers, ethische AI-experts, ontwerpers en ondernemers nodig. STEM staat voor Science, Technology, Engineering en Mathematics. 4. Bouwen aan vrouwgerichte technologie Waar de markt vrouwen negeert, kunnen Soroptimisten innovatie stimuleren: gezondheidsapps, financiële tools, educatieve platforms, veiligheids-AI. |

Een uitnodiging aan elke Soroptimist

AI verandert de wereld razendsnel. De vraag is niet meer of we met technologie te maken krijgen — maar of vrouwen mee vormgeven aan de technologie die ons leven stuurt.

Als vrouwen niet aan de ontwerptafel zitten, worden hun belangen niet ingebouwd in de toekomst. Als we dat wél doen, kan AI juist een krachtig middel worden voor gendergelijkheid en emancipatie.

Laten we daarom niet alleen toekijken, maar meebouwen.

Voor een digitale toekomst waarin vrouwenrechten niet opnieuw bevochten hoeven te worden — maar vanzelfsprekend zijn.

Meer leren? AIEqualityToolbox.com

Meepraten? admin@womenatthetable.net

Paneldiscussie

Tijdens de paneldiscussie werd duidelijk dat de positie van vrouwen in technologie opnieuw onder druk staat. Journalist en activist Arikia Millican schetste hoe vrouwen ooit de eerste programmeurs waren, maar door “the great exclusion” uit de techsector zijn geduwd. In de huidige AI-era is de vertegenwoordiging van vrouwen in AI-bedrijven verder verslechterd. Zij waarschuwde bovendien voor de werkwijze van grote AI-bedrijven die het internet, inclusief auteursrechtelijk materiaal, zonder toestemming gebruiken. “AI-bedrijven gedragen zich als vampieren”, aldus Millican. Haar oproep: ontwikkel systemen die uitgaan van consent in plaats van command, en stimuleer dat iedereen – vanuit elke expertise – zelf meebouwt aan betere AI.

Katarzyna Cieślak (Krakow University) toonde hoe AI genderbewuster kan worden ontworpen en getest. Door technologie te combineren met sociologisch inzicht en participatief ontwerp, kunnen we biases opsporen en vermijden.

In de dialoog met het publiek werd benadrukt dat niet alleen individuen, maar vooral het systeem moet veranderen. Belangrijk advies: stel kritische vragen, ontwikkel alternatieve modellen, voeg feministische data toe en neem de milieu-impact van AI mee in belangenbehartiging. De EU AI Act biedt daarbij een kans om structurele verandering af te dwingen.